如何遠離算法之“算計”?新規之下的網民算法素養調研

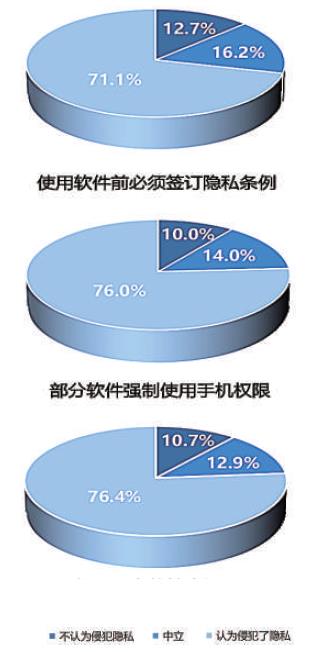

用戶對侵害隱私的感知情況

編者按

3月1日,國家互聯網信息辦公室等四部門聯合發布的《互聯網信息服務算法推薦管理規定》(簡稱《規定》)正式實施。《規定》對算法推薦服務做出全面規范,明確了算法治理體制機制,科學構建了網絡平台問責體系。隨之啟動的2022年“清朗·算法綜合治理”專項行動,要求督促整改算法不合理應用帶來的“信息繭房”“算法歧視”“大數據殺熟”等問題。上述新規及舉措是在數字化變革時代對算法治理的有效回應。在“與算法共存”的時代中,網民作為網絡行為主體,如何提升自身的算法素養,遠離算法之“算計”,更加安全自主地享受網絡生活?鑒此,光明日報聯合中央民族大學調研組,進行了問卷調查(有效問卷912人次)及深度訪談,就個人用戶的使用體驗,梳理了算法化生存中的困境、挑戰及具體應對表現,並就如何提升算法素養提出建議。

“以前總是被‘安排’看到自己‘想看’的內容,關閉個性化推薦后,感覺看到了更廣闊的世界。”“開了推薦,網購平台似乎比我更懂我,總讓我忍不住買買買﹔不開吧,又怕錯過合適的商品。”“關閉推薦之前,常刷到的短視頻總讓我欲罷不能,有美妝教程、精致生活,關閉之后刷到的竟是情景惡搞、土味情話……我趕緊又默默打開了個性化推薦。”

…………

隨著《規定》發布,抖音、微信、淘寶、百度、京東、微博等App均已上線“個性化推薦”一鍵關閉功能。然而,調查中部分用戶對於“個性化推薦”關不關表示糾結:有人覺得關閉后“打開了新世界的大門”,也有人覺得關閉后降低了用戶體驗,難以適應。

從疫情防控中的行程追蹤到智能出行中的路況計算,從符合口味的資訊內容到滿足個性喜好的商品推薦……大數據時代,須臾不可離的算法已廣泛滲透到社會各個層面,成為人的“技術伴侶”。我們需要算法的存在,享受它所帶來的便利﹔同時又要對其帶來的控制和其他風險有足夠的識別與反抗能力。調查結果顯示,有56.9%的受訪者認為算法程序提升了電子產品使用體驗,但北京大學互聯網發展研究中心發布的《中國大安全感知報告(2021)》也顯示,70%的調研對象擔心個人喜好與興趣被算法“算計”,50%表示在算法束縛下想要逃離網絡、遠離手機。

隱憂:

身處算法社會,我們正遭遇哪些困境?

潛藏在算法推薦之下的“差別化待遇”。3月初,北京市消協發布的互聯網消費大數據“殺熟”問題調查顯示,其在調查了16個平台、提取了32個模擬消費體驗樣本后發現,有14個樣本新老賬戶的價格不一致。調研發現,用戶與算法平台之間存在著鮮明的“信息溝壑”,平台掌握著算法的模型公式和呈現規則,通過對信息篩選標准的個性化設計,以及對其他平台的“數據跟蹤”,讓用戶處在信息金字塔的底端。精准推薦的背后來自平台對個人數據的標簽化運算,進而是將用戶消費能力劃分為“三六九等”,形成算法歧視。

算法歧視不僅損害用戶利益,更會激化社會的原有偏見。調研發現,新聞推送中的女性、老年人等弱勢群體更容易受到人們的關注,有68.7%的受訪者認為“女司機”“女大學生”等帶有性別指向的詞匯更容易上熱搜,性別議題更易激起討論。平台利用“用戶畫像”和“貼標簽”區別個體、扁平化用戶,強化現實生活中的刻板印象,可能引發社會輿論。

無處可逃的信息收集與“隱私威脅”。熱播的黑色幽默短劇《大媽的世界》中有這樣一段情節:廣場舞大媽們正發愁買什麼顏色的演出服,此時王大媽隨口說了一句晚上吃西紅柿炒蛋,並拜托楊大媽去接“熊貓班”的外孫,結果手機購物App就分別給她推送了紅黃相間、黑白配色的衣服。平台以“偷聽”的方式竊取數據用以計算用戶的偏好,再“突襲式”地進行信息推薦,已引起普遍關注。調研中多位被訪者表示,置身於平台與算法聯手建立的系統中,被“偷聽”已成“家常便飯”。很多企業、App、第三方機構在共享用戶的個人信息之際,試圖掌控更多的個人隱私。訪談中,不少用戶表示,瀏覽器總能“記住”其搜索歷史並且同步到其他設備上,在首頁反復推送搜索過的同類內容,讓人有一種“被泄密”的不安感。

基於收集個人信息的算法推薦服務帶來的困擾不止於此。一方面,不當的推薦表現在“量”上,過多同質化的內容形成了信息冗余,容易使個體產生心理疲勞與隱私焦慮﹔另一方面,算法推薦的“度”也常常超出應該推薦的內容范圍,色情、低俗等有違主流價值觀的內容常常被置入開機頁誘導用戶點擊。

被算法過濾與掌控的“漸進式依賴”。“平時吃飯、遛娃我都會找App上排序靠前的餐廳和游樂場”,31歲的二胎媽媽孫穎表示,依靠應用平台推薦雖然也“踩過雷”,但這樣的選擇對於她而言更省時省力。互聯網時代,不少網民越來越多地將事物的優劣判斷交給算法。算法憑借著“優先”“分類”“聯想”“過濾”等機制在很大程度上建構了“人們在互聯網上的感知與現實”。調查顯示,超六成的受訪者會根據平台的排名、評分等數據做出個人決策,盡管他們並不認同排名靠前的商品或內容一定是更好的。

調研還發現,不少提供算法推薦服務的平台,更是通過將相關內容放在突出位置、屏蔽其他平台鏈接等方式,實現“入口壟斷”與“自我優待”。這些平台在熱搜榜、首屏、彈窗等重點環節,通過設置關鍵詞、定向推送等方式將特定內容推至榜單前列,暗中控制人們可關注的信息范圍。72.1%的被訪者認為平台會推薦與自身興趣相似的內容。當人們習慣由平台供應信息時,有可能陷入算法設置的“過濾氣泡”中,人委身成為數據的“附屬品”,漸漸喪失接觸多元信息的機會。

應對:

從“逃避”到“棲身”的用戶生存之道

從對“大數據殺熟”的詬病,到對“信息繭房”的熟知,普通用戶在強勢的算法技術應用面前,不得不選擇以妥協的方式忍受算法帶來的種種問題。調查中,超過半數受訪者表示自己意識到了平台或商家對個人信息的收集,但如果不勾選“用戶知情同意書”,就無法使用軟件所提供的功能。讓渡隱私來換取服務,成為普通人與算法共存時“無奈而自洽”的心態。然而,在“受制於算法”的大多數情形之外,仍有不少用戶選擇同算法“斗智斗勇”,規避算法的消極影響。

善用“反追蹤”策略的“數字隱身”。大學生高宇是社交平台的“重度用戶”,在和算法推薦日復一日的相處中,她練就了一身“躲避”算法的本領:“我每次在首頁刷到不想看的內容就會‘以迅雷不及掩耳之勢’劃過。”此外,她還在同一個社交平台注冊了“小號”,“大號用來追逐熱點資訊,小號用來發日常,這樣不想看到相關內容的時候就有個地方可以‘躲’了”。

當下,身處各類默認設置協議中的普通個體,發展出多元的“算法回避”策略。他們或更換手機號碼、建立多個賬號,以此迷惑算法﹔或採取不點贊、不發表、不評論的方式,減少在互聯網中的數字痕跡﹔或因不喜歡某些軟件的推薦機制而選擇關閉或停用,直至尋求到算法友好的替代性產品﹔或想辦法關閉手機收音功能,從硬件設備端對可能的算法監聽予以阻隔。這些方式呈現出共性的算法化生存之策——“斷連”與“隱形”。然而,調研中許多用戶表示雖然可以遠離算法軟件,卻無法躲避算法思維的連鎖反應。調查顯示,隻有54.9%的人認為這種逃避產生了效果,霸王條款、偷用隱私、強行定位等情況依然難以靠個體力量得到緩解。

“因地制宜”投喂算法的“反向規訓”。依據算法情境“因地制宜”地制定使用策略,主動探究算法運作的規則與思維方式,通過意圖鮮明的點贊、收藏、點擊“不感興趣”等行為設置自主偏好,甚至在感興趣的帖子下留言稱“大數據請記住我,多向我推送這樣的(帖子)”……調研發現,部分用戶選擇以主動“喂養”的方式尋求與算法的相處之道。

其中,一度活躍於“飯圈”的“數據粉”就是依靠與算法的“你來我往”試圖影響信息排序的一群人。“數據粉”群體通常通過組織信息點擊和發布,對偶像的作品點贊、帶話題轉發等,提高相關內容的熱度,從而影響算法,令與偶像相關的內容躋身更顯著的位置,高調搶佔大眾注意力。

借算法平台謀取紅利的“棲身式共存”。“以前我隻選感興趣的內容創作,但有一次偶然剪輯制作了一部爆款影視劇介紹,流量特別好,自此以后我開始琢磨怎麼才能更火。”余家豪是一名業余的視頻網站內容創作者,受和他類似感受的牽引,越來越多的MCN(多頻道網絡)及自媒體創作者全心“棲身”於算法主導的內容世界,迎合代碼規則、抓住流量密碼、實現商業變現,構成了算法化生存的另一種模式。調研中,在“是否主動迎合推薦機制發布內容”的回答中,選擇“是”的比重超過三分之二。調研也發現,部分內容生產者不惜使用“三俗內容”“打擦邊球”等方式迎合算法准則。

反思:

走出算法困境究竟難在哪裡?

平台價值觀嵌入算法程序,增加了普通個體察覺偏見的難度。調研中,接受訪談的算法工程師表示,算法並不是絕對客觀中立的技術,數據採集的范圍與平台的市場意圖等都會寫進代碼、影響樣本分布或數據集,從而將“傾向”與“立場”嵌入程序設計中。對於普通用戶而言,由於算法本身以數字、公式的方式呈現,具有“技術無意識”的特征,因此,個體更難察覺和追溯價值偏見的源頭。例如以“流量至上”為代表的畸形的內容評價體系就是算法邏輯潛移默化作用的結果。

算法設計方與社會公眾之間存在知識鴻溝,導致算法難以被理解和詮釋。按照行業慣例,大部分算法設計者並不會將運算的細節公之於眾,算法存在著看不見的“黑箱”。長期以來,這種不透明的機制被看作是“自然化”的存在,很少有人去質疑其合理性,嚴重影響了社會對算法的監督。算法工程師與其他社會主體之間缺少公開而持續的算法解釋環節,建立相關的多方算法溝通機制迫在眉睫。

算法使用者處於弱勢地位,加劇了個體維權難題。調研組發現,真正了解算法運行機制的人並不多,僅有43.0%的人認為自己熟悉算法,更多被訪者表示自己對算法“一知半解”“知道又好像不太熟悉”。在我國當下有關媒介素養的教育中,“算法素養”培育仍然缺位。歐盟委員會於2020年開始呼吁成員國各國培育公眾對算法系統功能及其影響的意識和素養。

開展算法治理的配套措施和機制尚未到位。作為日常技術,算法深刻改變了人們的生活,但社會尚未跟上算法發展的步伐。換言之,技術的發展並沒有完善的“基礎設施”來配套。同時,算法行業的倫理意識尚顯薄弱,缺少行業自治的倫理標准。有關算法推薦信息服務的管理規定雖然已經出台,但是與之相配套的治理算法的體制機制、保障措施還有待完善,整個社會對算法開展“協同共治”的氛圍意識和參與渠道,都需要持續探索、切實推進。

未來:

全面提升算法素養,與《規定》形成互補

《規定》出台讓自上而下的算法治理有了法理依據,但在自下而上的算法素養提升方面仍有較大差距,需從以下方面著手開展相關工作。

融通多元渠道,上好全民的“算法普及課”,形成社會共識與知識共享,打破“算法崇拜”。算法思維不僅應用於算法領域,也在更廣泛的層面上影響著實踐。增強算法思維,一方面要深入理解算法邏輯,提高運用計算思維、數據思維分析和解決問題的能力﹔另一方面,要防止走入“算法崇拜”的誤區,著力培養算法素養與人文素養兼容的新思維。如今,系統化的算法思維教育仍然缺位,亟須全民共上“算法普及課”,補上算法思維教育的缺口。2018年起,算法相關課程已寫進高中“新課標”,未來還需增加中小學算法課程,“從娃娃抓起”培養算法思維﹔加強算法科普讀物與影視作品創作,以文化產業助推算法思維教育﹔建立算法思維評價指標體系,推動算法思維教育科學化發展。

將提升算法素養與現有消費權益、隱私權益、特殊人群權利保護體系“有效對接”“精准匹配”,構建向上向善的算法傳播格局。配合《規定》對透明性、可解釋的算法規則的要求,基於公開的算法機制,增強用戶對算法過濾信息的辨別力,同時加強對熱點排序等功能的人工干預﹔在應對“隱私危機”方面,樹立個體信息保護意識,厘清個人普通信息與個人敏感信息邊界﹔在個人信息輸入頁面設置隱私泄露提醒,防止盲目泄露個人信息﹔加強隱私權相關案例的媒體報道,樹立公眾維權意識﹔加強理性消費、公平消費等知識宣傳,開通差異化定價投訴渠道,明確獎懲機制,嚴格整治“大數據殺熟”等侵犯消費者權益行為,幫助大眾避開“消費陷阱”。

構建“主流價值觀+行業倫理+公共監管”的協同治理體系,強化算法問責,營造合法規、有情懷、可追溯的算法開發環境。算法素養主體既包括算法使用者,也包括算法開發者。提升算法開發者的算法素養,更需要多元協力、攜手共治。應追蹤《互聯網信息服務算法推薦管理規定》等法規的實施效果,對違規應用算法技術的企業進行處罰、約談等,實現剛性約束﹔在行業內廣泛開展對算法倫理的宣傳與討論,加強主流價值觀的行業內宣傳,將社會公德和職業道德引入行業價值體系,實現柔性制約﹔督促互聯網行業建立實踐層面的操作規范,著意防范“算法偏見”“算法歧視”等現象,從開發設計環節追求算法公平,實現技術創新與倫理之間的平衡﹔推進算法開發過程公開化、透明化,引入公眾監督,營造依法、審慎、道德的行業環境。 (執筆人:毛湛文、白雪蕾﹔調研組其他成員:趙安琪、聶一丹、於昊、季芸、代寧)

分享讓更多人看到

- 評論

- 關注

第一時間為您推送權威資訊

第一時間為您推送權威資訊

報道全球 傳播中國

報道全球 傳播中國

關注人民網,傳播正能量

關注人民網,傳播正能量